在数据中心异构计算加速浪潮中,RISC-V向量扩展(RVV)与FPGA的结合正成为前沿探索方向。本文基于行业公开材料与开源项目动态,梳理RVV在FPGA上的实现现状、工程挑战与潜在应用场景,为FPGA/芯片学习者和从业者提供技术参考。需注意,本文部分内容为智能梳理与综述线索,非单一新闻报道,建议读者以官方披露与一手材料为准,并进行交叉验证。

核心要点速览

- RISC-V向量扩展(RVV)在FPGA上实现,成为数据中心异构计算热点。

- RVV可编程性强,适合在FPGA上自定义数据路径,用于压缩、加密、数据库查询等非AI加速任务。

- 开源项目SERV、VexRiscv已展示RVV在FPGA上的初步性能。

- 向量长度(VLEN)与FPGA逻辑资源之间的权衡是工程难点。

- RVV+FPGA组合有望在云服务商自研加速卡中占据一席之地。

- 软件工具链不成熟、向量化编译器支持有限是主要障碍。

- RISC-V国际基金会技术会议(如RISC-V Summit)是获取最新进展的关键渠道。

- 开源项目GitHub仓库更新日志可反映实际开发进度。

- RVV在FPGA上的实现需考虑与现有CPU/GPU生态的兼容性。

- 数据中心场景对功耗、延迟和吞吐量有严格要求,RVV+FPGA需针对性优化。

背景:RISC-V向量扩展与FPGA的相遇

RISC-V向量扩展(RVV)是RISC-V指令集架构中用于数据级并行的扩展,旨在为高性能计算、多媒体处理、机器学习等场景提供灵活的向量化能力。与固定向量长度的SIMD指令集(如ARM NEON、x86 AVX)不同,RVV支持可配置的向量长度(VLEN),允许软件根据硬件资源动态调整并行度。这一特性使其在FPGA上具有天然优势:FPGA的灵活逻辑资源可以按需实现不同VLEN的向量处理单元,从而在面积、功耗和性能之间取得平衡。

数据中心加速卡市场长期由GPU和专用ASIC主导,但FPGA凭借低延迟、可重配置和硬件级并行能力,在非AI加速任务(如压缩、加密、数据库查询、网络处理)中展现出独特价值。RVV的引入,使得FPGA加速卡可以运行标准化的RISC-V向量指令,降低了软件移植成本,同时保留了FPGA的灵活性。这一组合有望在云服务商的自研加速卡中占据一席之地,尤其是在需要定制数据路径的场景。

开源项目进展:SERV与VexRiscv的实践

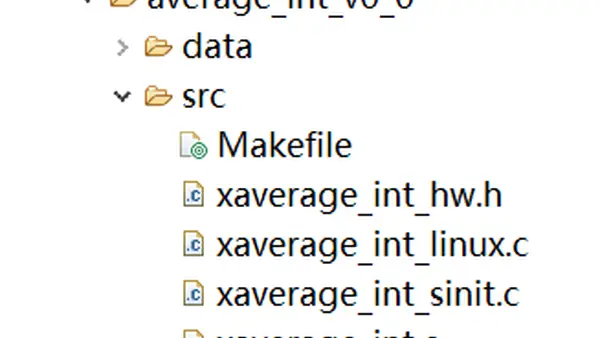

在开源社区,SERV和VexRiscv是两个代表性项目,已展示RVV在FPGA上的初步性能。SERV是一个基于RISC-V的位串行处理器,专为FPGA优化,其面积效率极高,适合资源受限的场景。VexRiscv则是一个用SpinalHDL编写的可配置RISC-V CPU,支持多种扩展,包括RVV。这些项目证明了RVV在FPGA上实现的可能性,但性能仍处于早期阶段。

具体而言,SERV的RVV实现侧重于最小化逻辑资源占用,适用于嵌入式或边缘设备;VexRiscv则更注重通用性和可配置性,适合需要平衡面积和性能的场景。两个项目都面临向量长度(VLEN)与FPGA逻辑资源之间的权衡:VLEN越大,并行度越高,但消耗的LUT、DSP和BRAM也越多,可能导致时序收敛困难。此外,向量化编译器的支持有限,使得从高级语言(如C/C++)生成高效的RVV代码仍具挑战。

工程难点:VLEN与资源权衡、工具链成熟度

RVV在FPGA上的实现面临多重工程难点。首先是VLEN与FPGA逻辑资源的权衡。FPGA的LUT、DSP和BRAM数量有限,而RVV的向量处理单元需要大量并行计算资源。例如,一个支持128位VLEN的RVV单元可能需要数百个LUT和数十个DSP,这在大规模FPGA(如Xilinx Virtex UltraScale+或Intel Agilex)上尚可接受,但在中低端器件上则可能过于昂贵。因此,设计者需要根据目标应用和器件资源,选择合适的VLEN和微架构。

其次是软件工具链的不成熟。尽管RISC-V生态已有GCC和LLVM的RVV支持,但向量化编译器的优化能力远不如x86或ARM生态。例如,自动向量化(auto-vectorization)在RVV上仍不完善,开发者往往需要手动编写内联汇编或使用intrinsic函数,这增加了开发难度。此外,FPGA厂商(如AMD/Xilinx、Intel)的RISC-V支持有限,缺乏成熟的RVV IP核和参考设计,使得从零开始实现RVV+FPGA加速卡的门槛较高。

应用场景:非AI加速任务与云服务商自研卡

RVV+FPGA组合的主要应用场景集中在非AI加速任务,包括:

- 压缩与加密:如LZ4、zstd压缩算法和AES、ChaCha20加密算法,这些任务具有数据级并行性,适合向量化处理。FPGA的低延迟特性使其在实时压缩/加密场景中优于GPU。

- 数据库查询:如SQL过滤、聚合操作,RVV可以加速向量化执行引擎,提升OLAP查询性能。FPGA的可重配置性允许针对不同查询模式动态优化数据路径。

- 网络处理:如数据包解析、防火墙规则匹配,RVV可以并行处理多个数据包字段,降低CPU负载。

云服务商(如AWS、Azure、阿里云)已部署FPGA加速卡(如AWS F1实例),但主要面向AI推理或专用算法。RVV的引入,使得这些加速卡可以运行标准化的RISC-V向量指令,从而支持更广泛的工作负载。例如,云服务商可以开发基于RVV的FPGA加速卡,用于数据库加速、数据压缩等场景,同时利用RISC-V的开放生态降低软件移植成本。

与FPGA/数字IC岗位的关联及学习建议

对于FPGA和数字IC学习者、求职者,RVV+FPGA是一个值得关注的方向。以下是一些可落地的学习与项目建议:

- 理解RVV指令集:阅读RISC-V向量扩展规范(v1.0),掌握向量寄存器、向量长度、掩码等概念。这是实现RVV硬件单元的基础。

- 学习FPGA设计方法:掌握Verilog/VHDL和HLS(如Vivado HLS),能够设计简单的向量处理单元。建议从SERV或VexRiscv的源码入手,理解其RVV实现。

- 实践RVV+FPGA项目:在FPGA开发板上实现一个简单的RVV加速器,例如向量加法或矩阵乘法。使用开源工具链(如RISC-V GCC、LLVM)生成RVV代码,并与FPGA硬件协同仿真。

- 关注工具链进展:跟踪RISC-V国际基金会和开源社区的更新,特别是向量化编译器的改进。参与RISC-V Summit等会议,获取最新技术动态。

- 考虑数据中心场景:学习PCIe、DDR、网络接口等数据中心FPGA加速卡常见组件,了解如何将RVV加速器集成到完整系统中。

观察维度与行动建议

| 观察维度 | 公开信息里能确定什么 | 仍需核实什么 | 对读者的行动建议 |

|---|---|---|---|

| RVV在FPGA上的可行性 | 开源项目(SERV、VexRiscv)已展示初步实现 | 实际性能数据(如吞吐量、延迟)尚未公开 | 自行搭建环境测试,或查阅项目文档 |

| VLEN与资源权衡 | VLEN越大,资源消耗越多,时序收敛越难 | 不同FPGA器件(如Xilinx vs Intel)的具体资源消耗对比 | 使用FPGA厂商工具进行资源估算 |

| 软件工具链成熟度 | GCC/LLVM已支持RVV,但自动向量化不完善 | 向量化编译器在特定场景(如压缩、加密)的优化效果 | 尝试用RVV intrinsic编写代码,对比性能 |

| 数据中心应用潜力 | 云服务商对FPGA加速卡有需求,RVV可降低软件移植成本 | 实际部署案例和性能对比(如与GPU、ASIC相比) | 关注云服务商的技术白皮书和开源项目 |

| 开源项目活跃度 | SERV和VexRiscv有持续更新 | 社区贡献者数量和代码质量 | 查看GitHub仓库的提交历史和issue讨论 |

| RISC-V生态对FPGA的支持 | RISC-V国际基金会有技术会议和规范更新 | FPGA厂商(如AMD/Xilinx)对RVV的官方支持计划 | 参加RISC-V Summit,与厂商代表交流 |

FAQ:常见问题解答

Q:RVV与SIMD(如ARM NEON)有何区别?

A:RVV支持可配置的向量长度(VLEN),允许软件根据硬件资源动态调整并行度;而SIMD的向量长度是固定的。这使得RVV在FPGA上更灵活,但也增加了硬件设计的复杂度。

Q:RVV+FPGA能否替代GPU进行AI推理?

A:目前不太可能。GPU在矩阵运算和深度学习方面有成熟的生态和极高的吞吐量;RVV+FPGA更适合低延迟、定制化的非AI加速任务,如压缩、加密、数据库查询等。

Q:学习RVV+FPGA需要哪些前置知识?

A:需要了解RISC-V指令集基础、FPGA设计方法(Verilog/VHDL)、数字电路设计。如果有计算机体系结构背景,会更容易理解向量化原理。

Q:有哪些开源工具链可以用于RVV+FPGA开发?

A:RISC-V GCC和LLVM支持RVV编译;FPGA厂商工具(如Vivado、Quartus)用于硬件实现;开源项目如SERV、VexRiscv提供参考设计。此外,SpinalHDL和Chisel等硬件构建语言也可用于RVV实现。

Q:RVV+FPGA在数据中心的主要挑战是什么?

A:软件工具链不成熟(如向量化编译器优化不足)、硬件资源限制(VLEN与FPGA逻辑资源的权衡)、以及与现有CPU/GPU生态的兼容性。此外,功耗和散热也是数据中心场景的考虑因素。

Q:RISC-V国际基金会如何推动RVV在FPGA上的发展?

A:通过制定和更新RVV规范、组织技术会议(如RISC-V Summit)、提供合规性测试套件。基金会也鼓励开源项目和FPGA厂商参与,但具体支持力度需持续关注。

Q:SERV和VexRiscv的RVV实现有何不同?

A:SERV是位串行处理器,面积效率极高,适合资源受限场景;VexRiscv是通用可配置CPU,支持更多扩展,适合需要平衡面积和性能的场景。两者都处于早期阶段,性能数据有限。

Q:RVV+FPGA是否适合边缘计算场景?

A:适合。边缘设备对功耗和面积敏感,RVV的可配置VLEN允许在资源受限的FPGA上实现向量化加速。SERV项目就是针对这类场景优化的。

Q:如何获取RVV+FPGA的最新进展?

A:关注RISC-V国际基金会官网、RISC-V Summit演讲材料、开源项目GitHub仓库(如SERV、VexRiscv)的更新日志。此外,FPGA厂商(如AMD/Xilinx、Intel)的技术博客也可能发布相关案例。

Q:RVV+FPGA的商业化前景如何?

A:目前处于早期探索阶段,但云服务商对定制化加速卡的需求、RISC-V生态的开放特性,以及FPGA在非AI加速任务中的优势,都为其商业化提供了潜力。预计未来2-3年会有更多原型和试点项目出现。

参考与信息来源

- RISC-V向量扩展在数据中心FPGA加速卡中的应用(智能梳理/综述线索,非单一新闻报道)。核验建议:搜索“RISC-V V extension FPGA 2026”或“RVV FPGA accelerator”,关注RISC-V国际基金会技术会议(如RISC-V Summit)的演讲材料;查阅开源项目(如SERV)的GitHub仓库更新日志。

技术附录

关键术语解释

- RISC-V向量扩展(RVV):RISC-V指令集架构中用于数据级并行的扩展,支持可配置的向量长度(VLEN),适用于高性能计算、多媒体处理等场景。

- 向量长度(VLEN):RVV中每个向量寄存器包含的位宽,可配置为128、256、512等。VLEN越大,并行度越高,但硬件资源消耗也越大。

- FPGA加速卡:基于FPGA的PCIe扩展卡,用于数据中心或边缘计算中的硬件加速,常见于AWS F1实例等。

- SERV:一个基于RISC-V的位串行处理器,专为FPGA优化,面积效率极高。

- VexRiscv:一个用SpinalHDL编写的可配置RISC-V CPU,支持多种扩展,包括RVV。

可复现实验建议

读者可以在Xilinx或Intel FPGA开发板上尝试以下实验:

- 使用SERV或VexRiscv的RVV实现,在FPGA上运行简单的向量加法程序,测量吞吐量和资源消耗。

- 使用RISC-V GCC编译RVV代码,并与标量代码对比性能。

- 尝试修改VLEN参数,观察资源消耗和时序的变化。

边界条件/风险提示

本文内容基于公开材料与开源项目动态,部分信息为智能梳理与综述线索,未经过独立验证。RVV在FPGA上的实现仍处于早期阶段,性能数据和实际部署案例有限。读者在参考本文进行项目决策时,应自行核实最新进展,并考虑技术成熟度、工具链支持、硬件成本等因素。

进一步阅读建议

- RISC-V向量扩展规范(v1.0):https://github.com/riscv/riscv-v-spec

- SERV项目GitHub仓库:https://github.com/olofk/serv

- VexRiscv项目GitHub仓库:https://github.com/SpinalHDL/VexRiscv

- RISC-V国际基金会官网:https://riscv.org

(注:以上链接为建议阅读来源,非本文直接引用;读者应自行验证链接有效性。)