在 2026 年英伟达 GTC 大会上,一项重磅发布彻底改写了 FPGA 的产业定位 —— 英伟达在全新 Vera Rubin 全栈 AI 计算平台中,将 FPGA 正式纳入Groq 3 LPX AI 推理标准架构,使其从 “可选配件” 升级为官方标配协处理单元。这一举措不仅确立了 FPGA 在 AI 推理领域的核心地位,更标志着 “GPU+FPGA” 异构架构正式成为全球 AI 推理规模化商用的主流范式,为整个 FPGA 行业,尤其是国产 FPGA 产业,打开了全新的增长空间。

一、核心方案:Groq 3 LPX 机架,FPGA 成标配调度核心

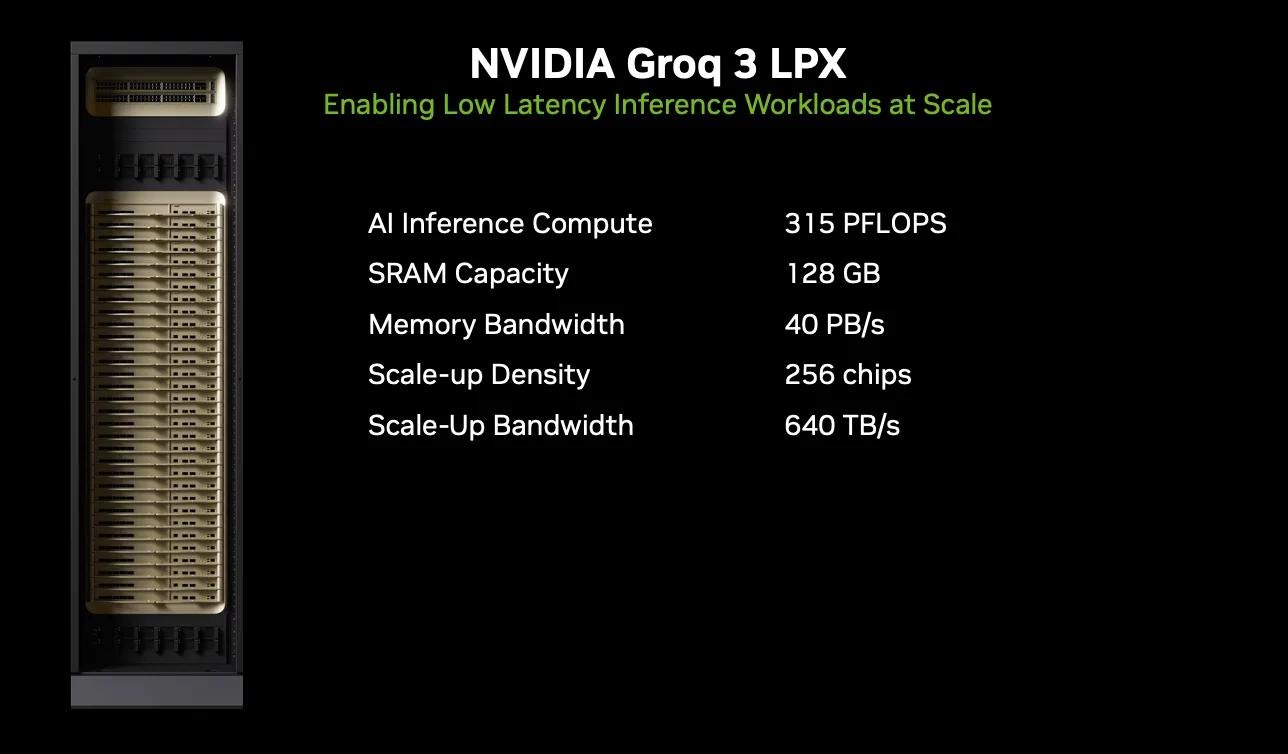

本次英伟达发布的 Groq 3 LPX 机架,是专为低延迟、高并发大模型推理场景设计的异构加速系统,预计 2026 年下半年正式出货。其核心配置中,FPGA 的地位被提升至前所未有的高度:

- 单机架标配 32 颗 FPGA:整个机架包含 32 个 1U 计算托盘(Tray),每个托盘强制标配 1 颗 FPGA,与 8 颗 Groq 3 LPU(语言处理单元)协同工作,无替代方案。

- 单颗 FPGA 价值约 1.2 万美元:仅单机架 FPGA 硬件价值就高达38.4 万美元,高端 AI FPGA 的商业价值得到官方背书。

- 核心功能:可编程链路调度 + 负载均衡:FPGA 主要负责 LPU 芯片间的灵活互连、动态任务调度与负载均衡,弥补 LPU 纯 SRAM 架构执行僵化的短板,同时承担协议转换、推理任务预 / 后处理加速等关键工作,是整个机架的 “调度中枢”。

- 架构逻辑:GPU+FPGA+LPU 异构协同:在 Vera Rubin 平台中,GPU 负责大模型预填充与注意力计算,LPU 专攻低延迟解码,而 FPGA 则贯穿始终,承担异构节点互连与任务编排,实现 “高吞吐 + 低延迟” 的最优组合。

二、产业影响:百亿级增量市场爆发,国产替代迎历史性机遇

英伟达的官方定调,直接引爆了 FPGA 在 AI 推理领域的增量市场,行业格局迎来重构:

- 全球 FPGA 市场天花板彻底打开

据行业数据,2025 年全球 FPGA 市场规模约 125 亿美元。仅 Groq 3 LPX 机架这一场景,若按年需求 37.5 万颗 FPGA 计算,对应增量市场规模高达45 亿美元,直接推动全球 FPGA 市场规模扩容超 35%。伴随 AI 服务器大规模部署,FPGA 年需求将突破 350 万片,成为驱动行业增长的核心引擎。 - 国产 FPGA 从 “边缘配套” 走向 “核心战场”

当前全球 FPGA 市场由海外厂商高度垄断,国产化率不足 10%。而英伟达将 FPGA 纳入 AI 推理标准架构,为国产厂商创造了黄金替代窗口: - 政策 + 技术双驱动:国内 AI 算力自主可控需求迫切,国产 FPGA 在 28nm/16nm 工艺已实现成熟量产,安路科技、紫光同创等厂商已具备全流程研发能力,可快速适配 AI 推理场景需求。

- 场景落地加速:国产 FPGA 凭借高性价比与本地化服务优势,已成功导入头部互联网企业与 AI 算力服务商,在 AI 推理、数据中心等核心领域实现从 “0 到 1” 的突破。

三、技术逻辑:为什么是 FPGA?——AI 推理的 “最优解”

英伟达选择 FPGA 作为 AI 推理标准核心,本质是由 FPGA 的技术特性与大模型推理的核心需求高度匹配决定的:

- 低延迟 + 高灵活性:FPGA 可编程硬件逻辑可实现纳秒级延迟,且能动态重构电路,适配不同大模型的推理需求,这是 GPU 与专用 ASIC 无法同时兼顾的核心优势。

- 异构互连核心:在 “GPU+LPU+FPGA” 异构架构中,FPGA 是唯一能实现多芯片间高速、低延迟互连的器件,可有效解决大规模推理集群的通信瓶颈。

- 成本与性能平衡:相比专用 ASIC,FPGA 无需高额流片成本,且可编程特性可适配快速迭代的 AI 算法;相比 GPU,FPGA 在低延迟推理场景下能效比更高,更适合大规模部署。

四、成电国芯解读:抓住 AI 浪潮,FPGA 人才迎来黄金时代

英伟达的官宣,不仅是 FPGA 行业的里程碑事件,更是每一位 FPGA 开发者、学习者的重大机遇。在 AI 算力自主可控的大背景下,国产 FPGA 产业正迎来 “技术突破 + 市场爆发” 的双重红利,掌握 FPGA AI 开发技能,将成为立足行业的核心竞争力。

成电国芯云课堂深耕 FPGA 人才培养,紧扣行业前沿动态,已推出适配 AI 推理场景的 FPGA 实战课程,涵盖 “FPGA+LPU” 异构开发、低延迟调度逻辑设计、大模型推理加速等核心内容,助力开发者快速掌握行业刚需技能,抓住 AI 浪潮下的 FPGA 黄金机遇。需要我把这篇文章改编成适配公众号排版的版本,补充关键数据标注和重点内容加粗吗?