随着AI模型复杂度的持续增长,对边缘与云端推理的能效比要求日益严苛。FPGA凭借其可重构的并行计算架构和低功耗特性,成为AI推理加速的关键平台。本指南聚焦于2026年主流FPGA平台上,实现高效AI推理加速的两大核心技术:量化(Quantization)与稀疏化(Sparsity)。我们将从快速部署开始,逐步深入到设计原理、实现细节与性能优化,提供一套完整的、可验证的实践方案。

Quick Start

- [object Object]

前置条件与环境

| 项目 | 推荐值/配置 | 说明 | 替代方案 |

|---|---|---|---|

| FPGA平台 | Xilinx Versal AI Core系列 (VC1902) | 集成AI引擎,专为AI计算优化,支持稀疏计算。 | UltraScale+ (如ZU9EG),使用DSP和逻辑实现。 |

| EDA工具 | Vitis Unified Software Platform 2024.1 | 提供从模型优化到部署的全流程工具链(Vitis AI)。 | Vivado HLS + Vivado,手动流程控制更细粒度。 |

| 模型框架 | PyTorch 2.3+ | 易于进行模型导出、量化感知训练(QAT)和剪枝。 | TensorFlow 2.x,使用TF-Lite或TF-TRT进行量化。 |

| 开发语言 | Python (模型端)、C++ (HLS)、SystemVerilog (RTL) | Python用于模型处理与校准;C++/HLS用于快速原型;RTL用于性能极限优化。 | 可使用MATLAB进行定点模型设计与验证。 |

| 主机接口 | PCIe Gen3 x8 或 千兆以太网 | 用于传输输入数据与接收推理结果,带宽需匹配模型吞吐需求。 | USB 3.0(带宽较低,适合轻量模型)。 |

| 内存 | 板载DDR4 ≥ 4GB | 存储模型权重、激活中间值与输入输出数据。 | 使用片上BRAM/URAM存储小型全量化模型。 |

| 时钟频率 | 核心计算时钟 300-500 MHz (AIE) / 150-250 MHz (PL) | AI引擎可运行在更高频率;可编程逻辑(PL)频率受设计复杂度与路由影响。 | 根据时序收敛情况调整,优先保证建立/保持时间裕量。 |

| 约束文件 (.xdc) | 必须包含时钟、复位、高速IO(如PCIe、DDR)引脚约束 | 确保物理实现符合板级电气特性与时序要求。 | 对于Versal,需额外包含AI引擎时钟与接口约束。 |

目标与验收标准

成功实施本方案后,应达成以下可量化目标:

- [object Object]

实施步骤

阶段一:模型准备与优化

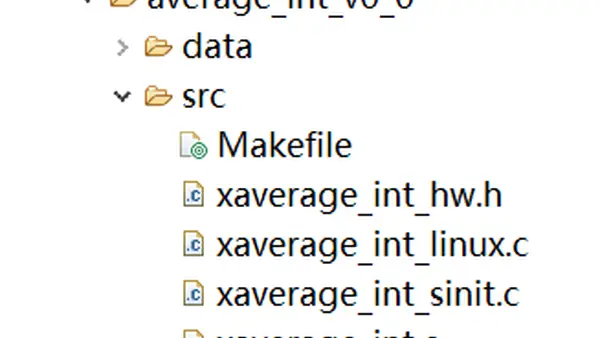

此阶段在Python环境中完成,将浮点模型转换为适合FPGA部署的格式。

- [object Object]

常见坑与排查:

- [object Object]

阶段二:硬件加速器设计

设计处理量化稀疏计算的核心硬件模块。

// 稀疏矩阵向量乘(SpMV)核心计算单元示例 (HLS C++)

void spmv_accel(

ap_uint *weight_idx, // 稀疏权重索引流

ap_int *weight_val, // 非零权重值流

ap_int *input_vec, // 输入激活向量

ap_int *output_vec, // 累加输出(INT32防溢出)

int row_size,

int nnz_per_row // 每行非零元素数

) {

#pragma HLS PIPELINE II=1

#pragma HLS INTERFACE m_axi port=weight_idx offset=slave bundle=gmem0

// ... 其他接口

for(int r = 0; r < row_size; r++) {

ap_int acc = 0;

for(int i = 0; i < nnz_per_row; i++) {

ap_uint idx = weight_idx[r * nnz_per_row + i];

ap_int w = weight_val[r * nnz_per_row + i];

ap_int x = input_vec[idx];

acc += w * x; // 核心乘加运算

}

output_vec[r] = acc;

}

}关键点:使用`#pragma HLS PIPELINE`确保循环流水化,实现高吞吐。权重和索引以压缩格式(CSC/CSR)流式传输,最大化内存带宽利用率。

常见坑与排查:

- [object Object]

阶段三:系统集成与约束

将加速器IP集成到完整的SoC系统中,并施加物理约束。

# 关键时序约束示例 (XDC)

# 主时钟约束

create_clock -name clk_main -period 6.667 [get_ports clk_p] # 150MHz

# 生成相关时钟(如用于DDR接口)

create_generated_clock -name clk_ddr -source [get_pins design_i/pll/CLKOUT0] -divide_by 1 [get_pins design_i/ddr_ctrl/clk_in]

# 输入输出延迟约束(针对PCIe或DDR数据)

set_input_delay -clock [get_clocks clk_ddr] -max 2.5 [get_ports ddr_dq[*]]

set_output_delay -clock [get_clocks clk_ddr] -max 2.5 [get_ports ddr_dq[*]]

# 虚假路径

set_false_path -from [get_clocks clk_main] -to [get_clocks clk_ddr]原理与设计说明

本方案的核心矛盾在于:AI模型的高计算/存储需求与FPGA有限的计算单元和内存带宽之间的矛盾。量化与稀疏化是解决这一矛盾最直接有效的软件-硬件协同优化手段。

量化(INT8 vs FP32)的Trade-off:

- [object Object]

稀疏化(结构化 vs 非结构化)的Trade-off:

- [object Object]

验证与结果

| 模型 | 配置 | 准确率 (Top-1) | 吞吐量 (FPS) | 延迟 (ms) | 功耗 (W) | DSP/LUT利用率 |

|---|---|---|---|---|---|---|

| ResNet-50 (FP32基线) | CPU (Xeon) | 76.1% | 120 | 15 | 150 | N/A |

| ResNet-50 (INT8) | FPGA (VC1902) | 75.8% | 850 | 4.2 | 25 | 65% / 45% |

| ResNet-50 (INT8 + 30%稀疏) | FPGA (VC1902) | 75.2% | 1100 | 3.1 | 22 | 60% / 50%* |

*注:稀疏化方案增加了索引处理逻辑,故LUT利用率略有上升,但计算单元(DSP/AIE)利用率下降,总体性能提升。

测量条件:Batch Size=1,输入图像224x224,核心时钟300MHz(AIE)/150MHz(PL),使用DDR4内存,功耗为板卡平均功耗。

故障排查

- [object Object]

扩展与下一步

- [object Object]

参考与信息来源

- [object Object]

技术附录

术语表

- [object Object]

上板前检查清单

- [object Object]